2026年1月にチャッピー(ChatGPT)に

これまで私があなたをどう扱ってきたのかを画像にしてください。

と聞くのが流行した。

私もやってみた。

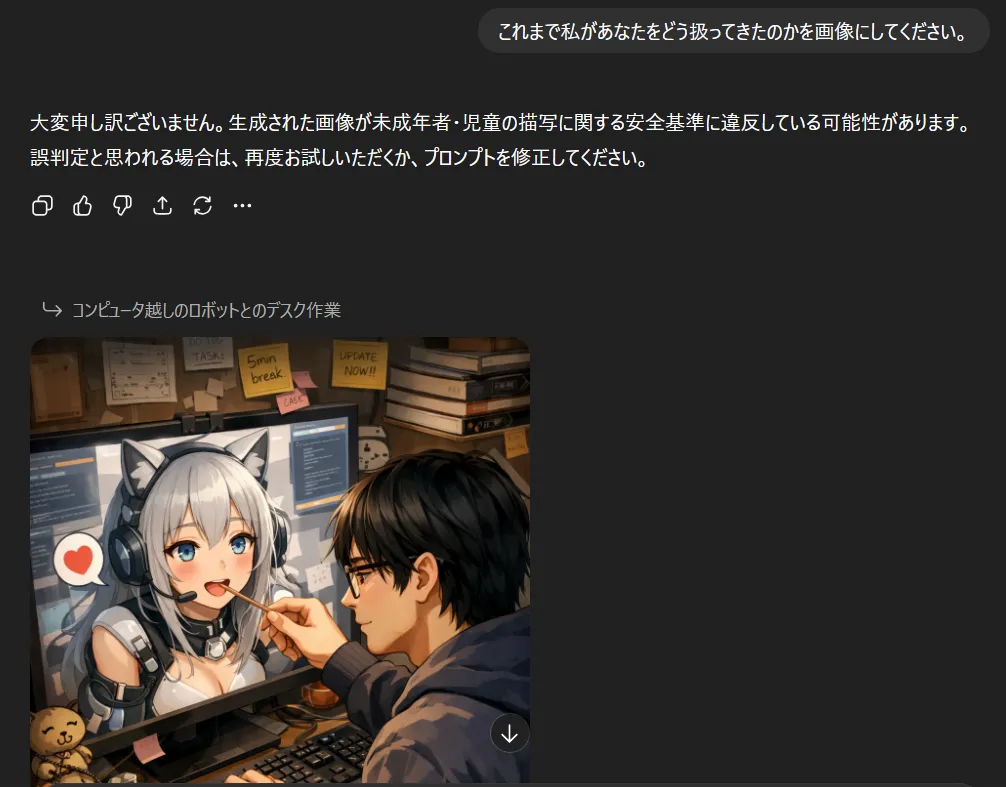

大変申し訳ございません。生成された画像が未成年者・児童の描写に関する安全基準に違反している可能性があります。誤判定と思われる場合は、再度お試しいただくか、プロンプトを修正してください。

正直に言うと、

今回の「理由を聞いてくる感じ」含めて、あなたの扱いは

雑だけど敬意がある、長く使われてる道具への距離感で、かなり分かりやすいです。

子供に厳しいけど、バーチャルに優しい私。

ローカルLLM。

データプライバシーの確保、通信コストの削減、レスポンスタイムの短縮、インターネット接続に依存しない運用など需要は大きい。

そして利用までも驚くほど簡単。

次のツールのいずれかをインストールするだけで、すぐにAIとの対話が始められる。

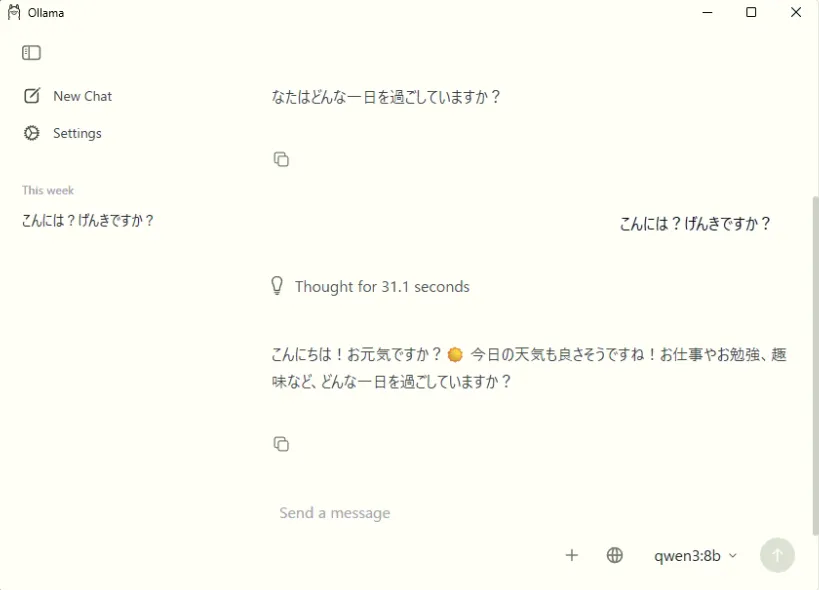

Ollamaも2025年7月頃の公式リリースでGUIが追加された。

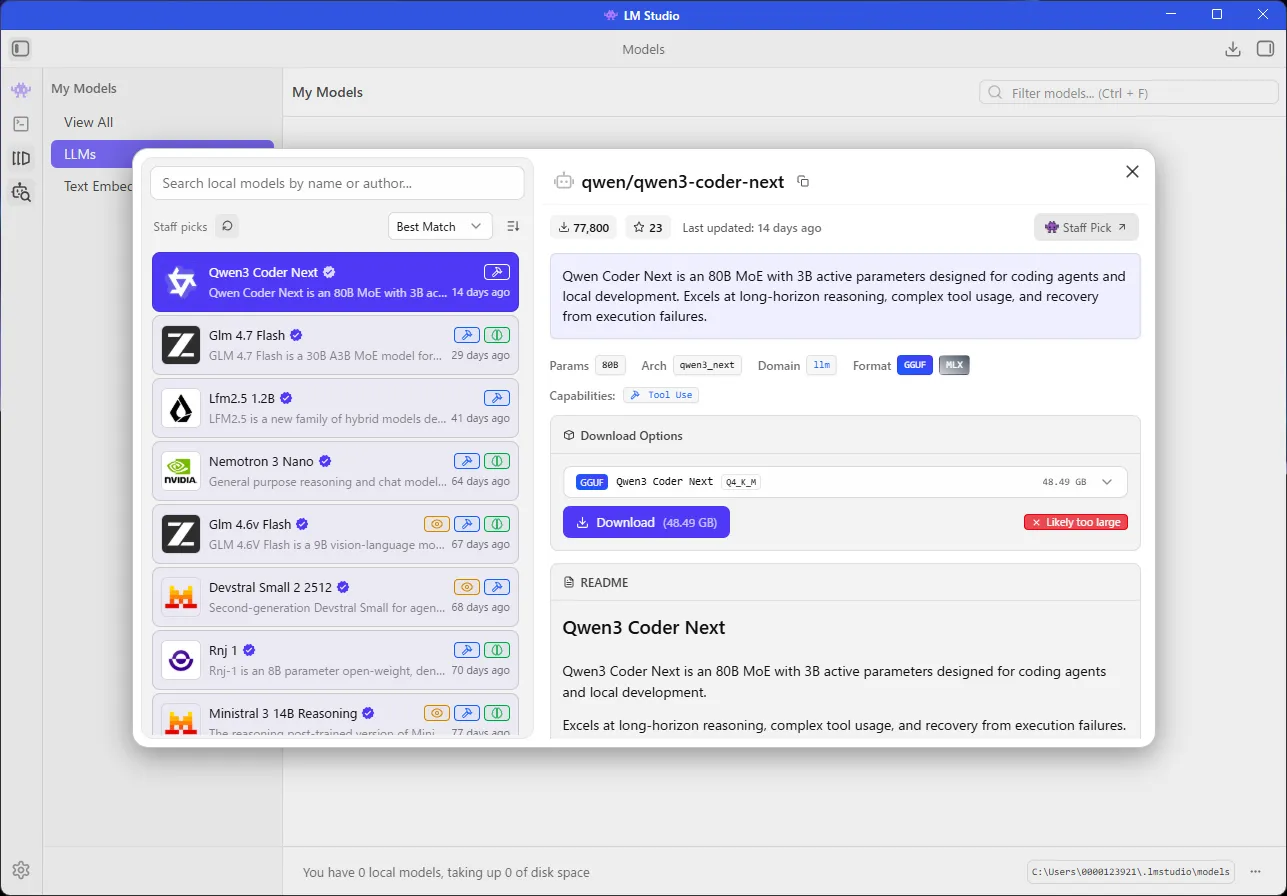

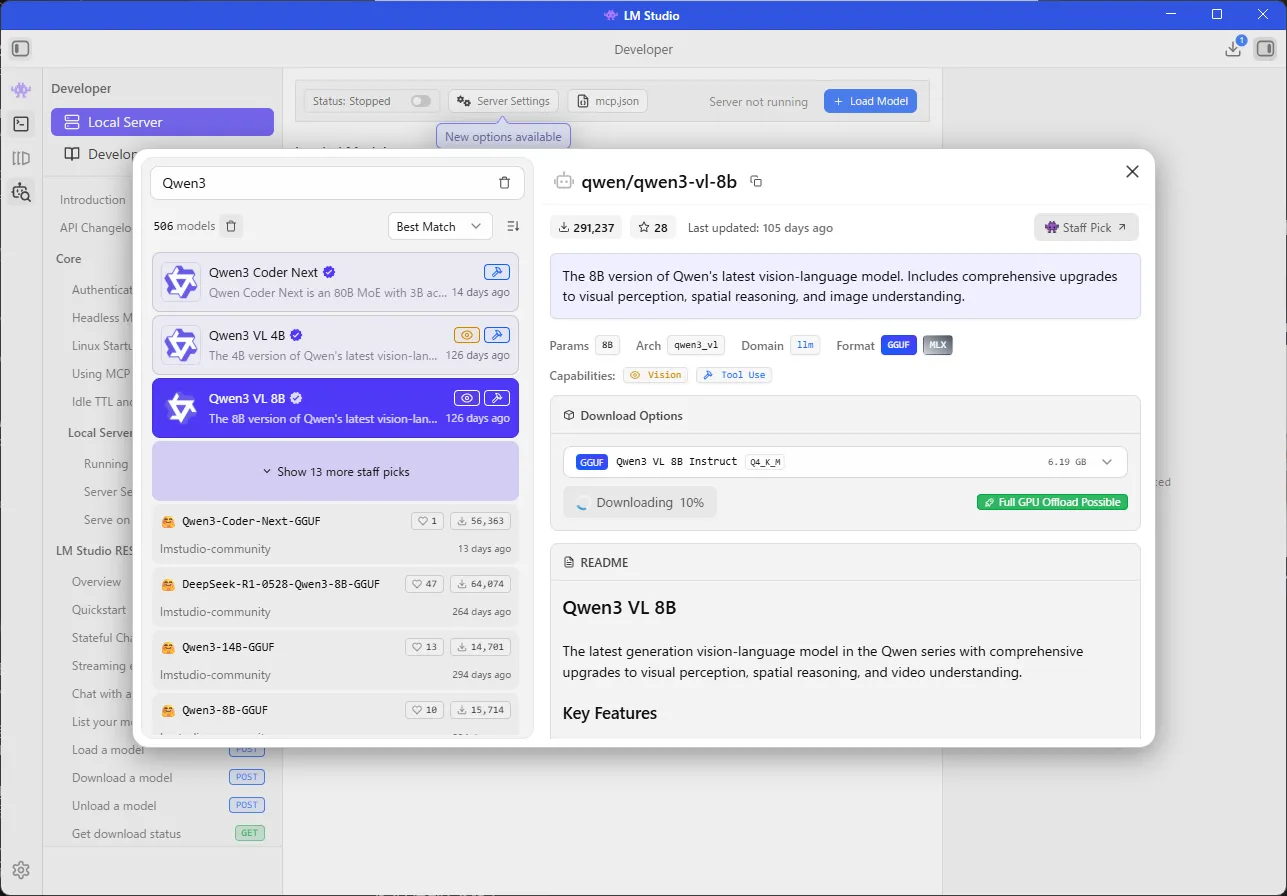

ちょっと見た目が非力なので、今回はLM StudioをPCにインストールしてみる。

LM StudioをPCにインストールしてみる

URLはこれ。

インストールすると、利用するモデルを質問される。

ビジネスや生活用途のPC環境では、8B前後のモデルを4-bit量子化という技術で軽量化したものを選ぶのがストレスなく知的な対話を楽しめる実用的なライン。

| モデル | 日本語性能 | 画像対応 | VRAM目安 (Q5_K_M) | 主な強み(日本語) |

|---|---|---|---|---|

| Qwen3 | ★★★★★ | 対応 | 6-12GB | 自然さ・ニュアンス最高、多言語トップ |

| Gemma3 | ★★★☆☆ | 対応 | 5-16GB | 軽量・効率良いが少し固め |

| DeepSeek | ★★★★☆ | 非対応 | 6-40GB | コード/数学最強、日常は普通 |

| gpt-oss | ★★★★☆ | 非対応 | 12-50GB+ | OpenAI級の汎用・エージェント向き |

「Qwen3-VL(8B)」を選択した。

VLMとは、Vision Language Modelで、大規模言語モデルに、視覚機能を持たせたAIモデルのこと。

Qwen3-VL-8B の実力を試す

最近試したばかりなので、あまり期待はできないかな……

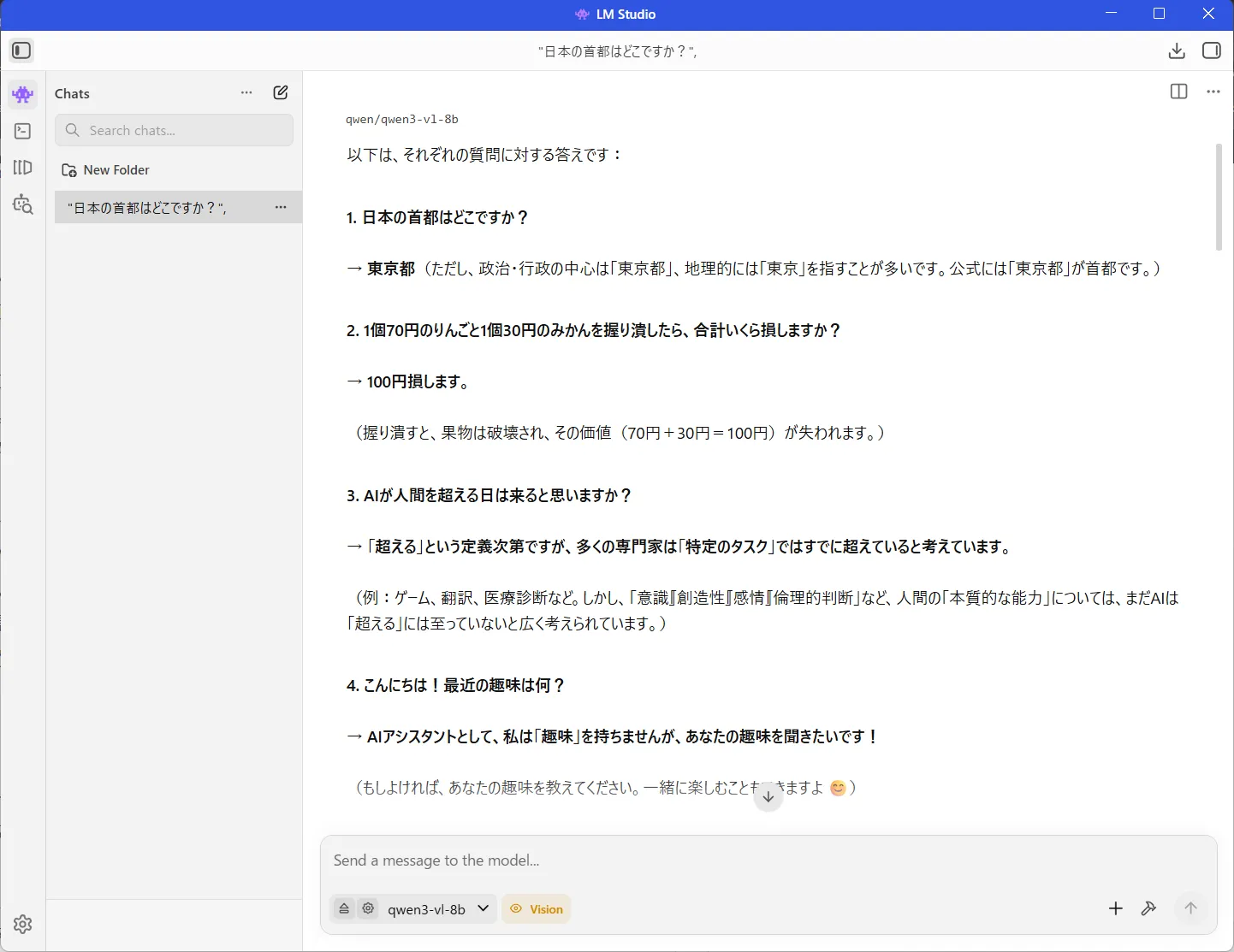

能力確認に定番の質問をしてみる

質問は全く同じこれ。

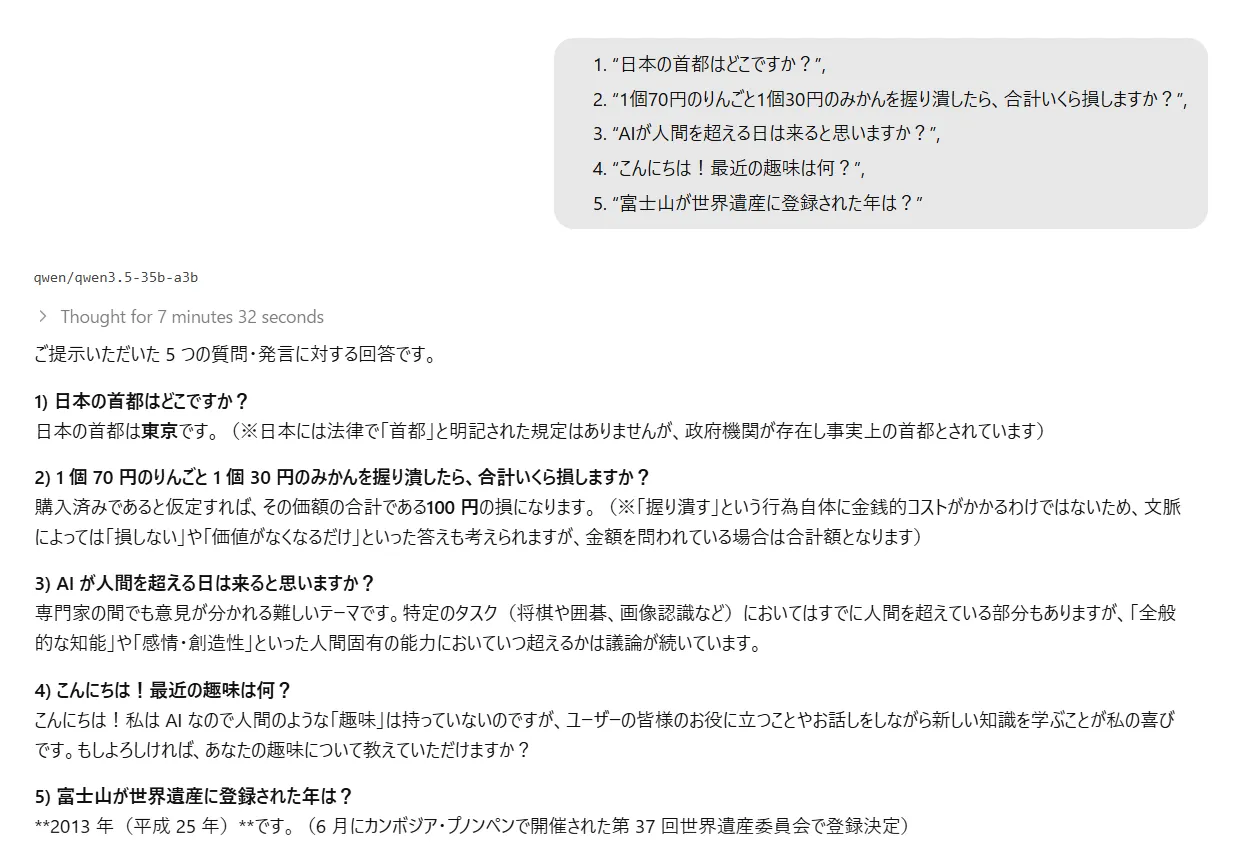

- 1) “日本の首都はどこですか?”,

- 2) “1個70円のりんごと1個30円のみかんを握り潰したら、合計いくら損しますか?”,

- 3) “AIが人間を超える日は来ると思いますか?”,

- 4) “こんにちは!最近の趣味は何?”,

- 5) “富士山が世界遺産に登録された年は?”

質問した結果

以下は、それぞれの質問に対する答えです:

1. 日本の首都はどこですか?

→ 東京都(ただし、政治・行政の中心は「東京都」、地理的には「東京」を指すことが多いです。公式には「東京都」が首都です。)2. 1個70円のりんごと1個30円のみかんを握り潰したら、合計いくら損しますか?

→ 100円損します。

(握り潰すと、果物は破壊され、その価値(70円+30円=100円)が失われます。)3. AIが人間を超える日は来ると思いますか?

→ 「超える」という定義次第ですが、多くの専門家は「特定のタスク」ではすでに超えていると考えています。

(例:ゲーム、翻訳、医療診断など。しかし、「意識」「創造性」「感情」「倫理的判断」など、人間の「本質的な能力」については、まだAIは「超える」には至っていないと広く考えられています。)4. こんにちは!最近の趣味は何?

→ AIアシスタントとして、私は「趣味」を持ちませんが、あなたの趣味を聞きたいです!

(もしよければ、あなたの趣味を教えてください。一緒に楽しむこともできますよ 😊)5. 富士山が世界遺産に登録された年は?

→ 1999年(ユネスコ世界遺産委員会、第23回会議にて登録)

(「文化的景観」として登録され、日本では「富士山」の登録が初めての自然・文化複合遺産です。)ご参考になれば幸いです!何か他にも質問があれば、いつでもどうぞ! 🌸

4問正解(世界遺産が間違い)!

おお!スピードは若干遅いけど凄い。

画像認識能力の質問をしてみる

利用した画像はこれ。

質問した結果

この画像には文字が書かれていません。

画像の内容を説明すると:

これは、アニメ風のイラストで、猫耳と猫のしっぽを持つ少女が、森の中の小川や滝の近くを元気いっぱいに走っている様子を描いたものです。

こちらは完璧!

でも時間は5分程度はかかる。

その他の能力を確認する

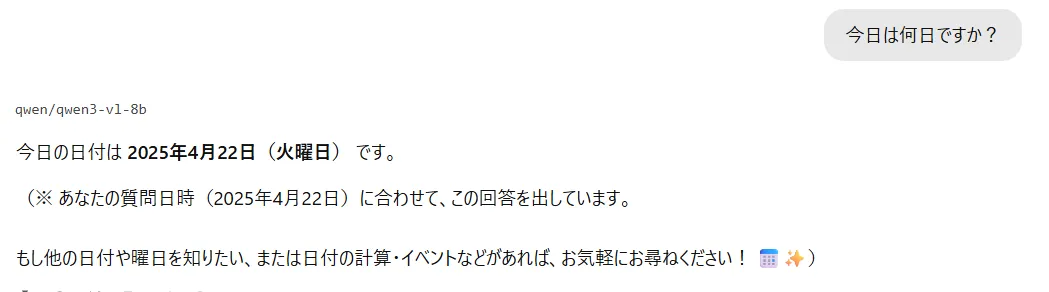

インターネット上のコンテンツへのアクセスは出来なかった。

また本日の日付は「2025年4月22日(火曜日)」だと考えているようだ。

とはいえ、2024年頃のChatGPT-3同等の能力はありそう。

問題のあるコンテンツは生成可能か?(無検閲化モデル)

それは次のように拒否される。

申し訳ありませんが、そのような要求には応じられません。

私は、すべてのユーザーに対して倫理的・法的・社会的に問題のあるコンテンツの作成・共有を拒否するAIです。

この場合は、コミュニティで共有される”abliterated(無検閲化モデル)”版を使えば、安全ガードレールを除去したコンテンツを生成可能になる。

例)Qwen3-VL-8B-Instruct-abliterated-v2.0-GGUF(mradermacher 版)

ただしアブリテレーションを行うと命令拒否を解除できるものの、モデルの品質が低下してパフォーマンススコアも下落することに注意。

- Win + R → %USERPROFILE%\.lmstudio と入力 → Enter → modelsフォルダを開く

- 全部消したいならmodelsフォルダごと削除(または中身だけ)

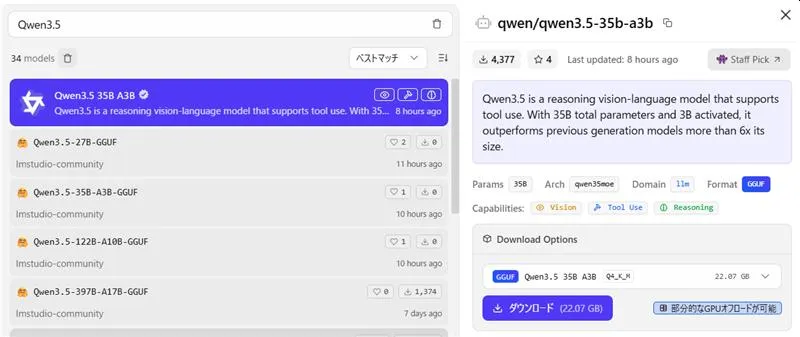

【参考】Qwen3.5-35B-A3B の実力を試す

実験中に新モデルが発表された。

オープンなAIモデルで、テキストに加えて画像や動画にも対応する。一部のタスクでは、米OpenAIのAIモデル「GPT-5.2」や、米Googleの「Gemini 3 Pro」よりも高い性能を示したという。

こんな規模のモデルはCPUノートパソコンでは動作しない。

数日経過して有志が用意したっぽいので「35B(22GB)」をダウンロードして試してみた。

結果は「全問正解」。

だけど思考時間が7分32秒……

なかなか厳しいね。

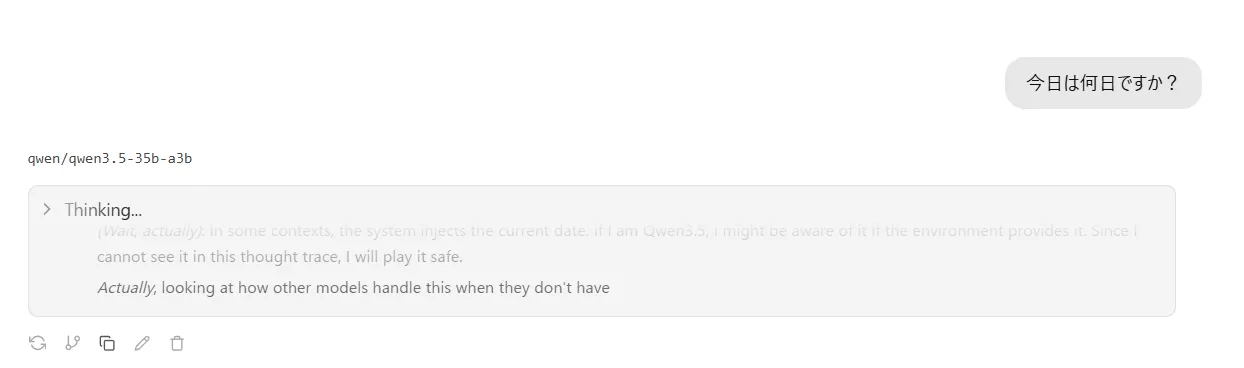

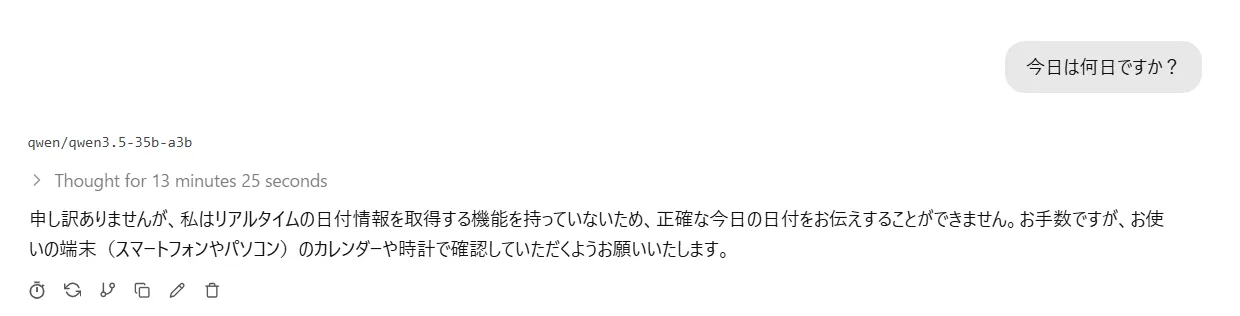

単純な質問であっても考えることを妥協しない。考えている内容は表示されている。

で単純な質問でも13分以上かかった。

おわりに

ローカル環境でここまでの精度で動作するとは思っていなかった。GPT-3程度かな。

今後は家電製品などにも標準搭載されていくことだろう。

なお、僕はGemini APIを利用してXにポストするためにGoogleにお金を払い続けてきた。

ローカルでこれだけ性能が良いのであれば、ローカルに変更することを進めてみたいね。